一、模型下载

这次还是选用的Qwen2.5,自己想办法下载下来吧。之前的教程中有下载的介绍。

这里为什么要选用Qwen2.5而不用llama3,因为function calling是需要较新的模型才支持。Qwen2.5就比较新。

二、ollama安装

点击这里进入ollama官方下载页面。

Linux的直接执行一个命令就行了。

window的下载后一直下一步。

三、gguf导入ollama

1.创建modelfile文件

ModelFile的具体详细介绍可以看官方的GITHUB文档

FROM Qwen2.5-q8_0.gguf

TEMPLATE """{{ if .System }}<|start_header_id|>system<|end_header_id|>

{{ .System }}<|eot_id|>{{ end }}{{ if .Prompt }}<|start_header_id|>user<|end_header_id|>

{{ .Prompt }}<|eot_id|>{{ end }}<|start_header_id|>assistant<|end_header_id|>

{{ .Response }}<|eot_id|>"""

PARAMETER stop "<|start_header_id|>"

PARAMETER stop "<|end_header_id|>"

PARAMETER stop "<|eot_id|>"

PARAMETER stop "<|reserved_special_token"FROM为必填,是模型的绝对路径,或者modelfile的相对路径。

格式为GGUF使需要精确的文件后缀。

格式为safetensors时,需要精确到模型的根目录文件夹

2.执行导入命令

执行以下命令

ollama.exe create name:version -f Modelfile需要自己更改一下大模型的版本和名称,Modelfile是上面一步文件的完整路径

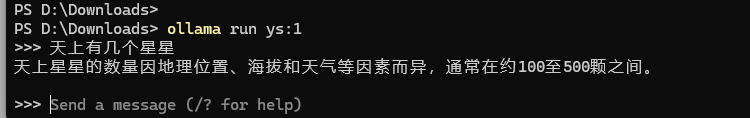

3.命令行中运行启动并测试大模型

导入完成过后执行以下命令可以进入大模型,并且测试。需要改为自己的名字和版本

ollama run name:version